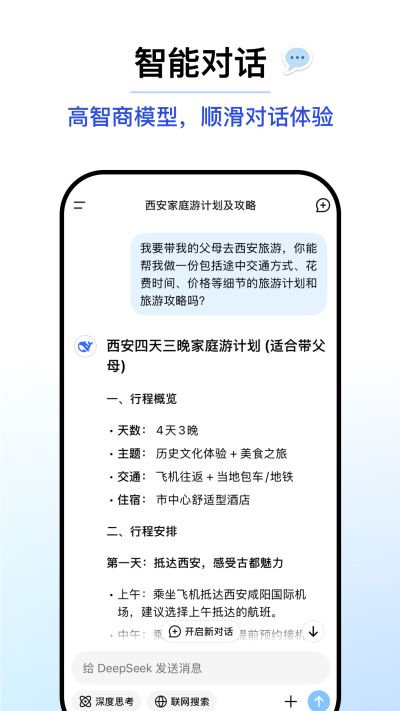

deepseek app是由DeepSeek官方推出的AI助手,用户安装后即可免费与性能世界领先的DeepSeek-V3模型互动交流。DeepSeek App支持中国大陆手机号码、微信与Apple ID(仅限iOS)一键登录,同一账号内历史对话记录与网页端实时同步,功能体验也与网页端全面对齐:支持联网搜索与深度思考模式,同时支持文件上传,能够扫描读取各类文件及图片中的文字内容,随时随地为用户答疑解惑、实现学习办公提效。

DeepSeek-V3:开源模型中的性能标杆

DeepSeek-V3在推理速度上相较历史模型实现了显著提升,大幅优化了响应效率与用户体验。

在当前主流大模型评测榜单中,DeepSeek-V3稳居开源模型首位,综合能力已可与全球最先进的闭源模型相媲美。

DeepSeek-R1重磅发布:对标OpenAI o1正式版

DeepSeek-R1 发布,性能对标 OpenAI o1 正式版

DeepSeek正式推出全新推理模型 DeepSeek-R1,并同步开源全部模型权重,推动技术普惠与社区共创。

- 采用 MIT License 开源授权:允许用户基于 DeepSeek-R1 进行蒸馏训练,自由构建衍生模型。

- 上线官方 API 接口:开放思维链(Chain-of-Thought)输出能力,开发者只需设置

model='deepseek-reasoner'即可调用。 - 全平台同步上线:DeepSeek 官网与 App 已全面更新,用户可立即体验 R1 模型的强大推理能力。

性能对齐 OpenAI o1 正式版

DeepSeek-R1 在后训练阶段大规模应用强化学习技术,在极少人工标注数据的前提下,显著提升了模型在复杂任务中的推理表现。其在数学、代码生成与自然语言推理等关键领域,性能已与 OpenAI o1 正式版相当。

DeepSeek团队已将 R1 的完整训练技术细节公开,旨在促进技术社区的深度交流与协同创新。

论文链接:https://github.com/deepseek-ai/DeepSeek-R1/blob/main/DeepSeek_R1.pdf

蒸馏小模型超越 OpenAI o1-mini

在开源 DeepSeek-R1-Zero 与 DeepSeek-R1 两款 660B 大模型的同时,团队利用 R1 的高质量输出蒸馏出 6 个轻量级模型并开源。其中,32B 与 70B 版本在多项基准测试中表现优异,整体能力已对标甚至超越 OpenAI o1-mini。

HuggingFace 模型库地址:https://huggingface.co/deepseek-ai

更开放的许可证与用户协议

为切实推动开源生态发展,DeepSeek在本次发布中对授权策略作出重要调整:

- 统一采用 MIT License:所有开源仓库(含模型权重)均使用标准化、宽松的 MIT 许可证,完全开源、不限商用、无需申请。此前使用的 DeepSeek License 因理解门槛较高已被弃用。

- 明确支持模型蒸馏:用户协议已更新,正式允许用户利用 DeepSeek 模型输出进行蒸馏训练,以开发自有模型。

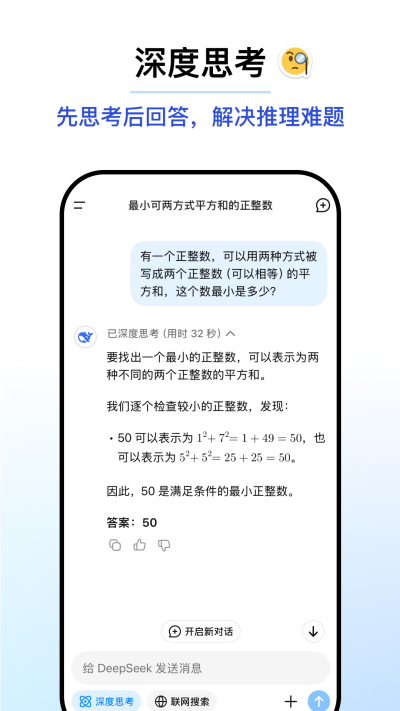

App与网页端无缝体验

用户可通过 DeepSeek 官网或官方 App,开启“深度思考”模式,直接调用最新版 DeepSeek-R1 执行高阶推理任务,享受一致的智能服务体验。

如何使用 DeepSeek

首次调用 API

DeepSeek API 兼容 OpenAI 接口规范,开发者可直接使用 OpenAI SDK 或其他兼容工具接入。只需将 base_url 配置为 https://api.deepseek.com/v1 即可(注:此处 v1 仅为 API 版本标识,与模型版本无关)。

deepseek-chat 模型已全面升级为 DeepSeek-V3,接口保持不变。调用时指定 model='deepseek-chat' 即可使用最新 V3 模型。

调用对话 API 示例

创建 API Key 后,可通过以下脚本访问 DeepSeek API。默认为非流式输出,设置 stream=true 可启用流式响应。

curl

python

nodejs

DeepSeek-R1 相较于 V3 的核心突破

DeepSeek-V3 与 R1 系列均基于 V3-Base 基础模型开发。但 R1 系列在后训练阶段引入了更先进的自我评估与自我奖励机制,通过纯强化学习(RL)路径实现能力跃升。

传统大模型普遍依赖 RLHF(基于人类反馈的强化学习),需大量高质量人工问答数据指导模型判断“何为好答案”。该技术曾助力 GPT-3.5 实现突破,但现已接近性能瓶颈。

DeepSeek-R1 系列彻底摒弃了 RLHF 中的人类反馈(HF)环节,仅保留纯强化学习(RL)机制。在 R1-Zero 初代版本中,团队设计了双奖励函数:一者验证最终答案的正确性(借助外部工具),另一者评估推理过程的逻辑连贯性(由小型验证模型打分),并鼓励模型生成多个候选答案进行自我评分与优选。

DeepSeek指出,R 系列模型在此过程中自发涌现出“反思”能力。

初期训练中,R1-Zero 输出存在语言混杂、可读性差等问题。但随着训练推进,模型开始自主进化,展现出“反思”行为——主动回溯初始思路、探索替代解法,这些复杂策略均未被显式编程。

据 DeepSeek 描述,这一“啊哈时刻”出现在训练中期:模型学会根据任务难度动态分配思考时间,重新评估初始方法。“这证明只要激励机制得当,模型能自发发展出高级问题解决策略。”经过数十万步纯强化学习迭代,R1-Zero 在推理基准上已匹配 OpenAI o1-0912 的水平。

团队在论文中强调:“这是首个验证大语言模型推理能力可**仅通过强化学习**激发、无需监督微调(SFT)的开放研究成果。”

为改善语言流畅性,DeepSeek在纯 RL 前增设“冷启动”阶段:先用数千条规范化的思维链(CoT)数据微调 V3-Base,使其掌握逻辑清晰的表达方式;随后开展强化学习,生成约 80 万条样本(含 60 万推理相关、20 万无关),再以此微调基础模型,最终得到兼顾准确性与流畅性的 DeepSeek-R1。值得一提的是,该 CoT 数据集亦用于微调 Qwen 系列模型,同样显著提升了其推理能力。

更新日志

v1.0.13版本

- 修复部分已知问题